导读:2026年初,BAT罕见地在同一时间窗口内同步布局“多人、多Agent”群聊功能,标志着AI交互范式从“一问一答”向“多智能体协作”的重大跃迁。本文将深度拆解群AI助手的技术原理、架构设计与面试考点,助你建立完整知识链路。

一、痛点切入:为什么我们需要群AI助手?

在传统聊天场景中,AI的交互模式一直是一对一的。用户提问,AI回答,结束。但当AI被放入一个多人同时在场的群聊环境中时,问题就出现了。

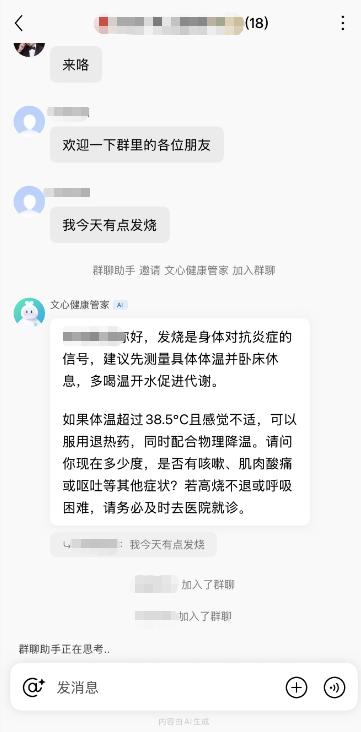

先看一段传统单Agent在群聊中的表现:

传统单Agent处理群聊消息的伪代码 def traditional_chatbot(message, user_id): 每次只处理一条消息,不知道上下文中有谁在说 response = llm.generate(f"用户{user_id}说:{message}") return response 直接输出,不考虑群聊氛围和发言时机

这种模式存在三个致命缺陷:

“瞎插嘴”问题:许多AI要么过于安静像个木头人,要么像话痨一样不分场合地发言。群聊中多人同时说话、话题变化快,AI缺乏判断“该不该说”的能力-7。

成本失控:现有系统在每个对话回合都调用大模型进行推理和生成,就像“雇佣了一个全职翻译官,即使没什么重要事情也在不断工作”,消耗大量计算资源-7。

隐私隐患:所有聊天内容都要发送到云端处理,“就像把私人日记交给陌生人看”-7。

这正是群AI助手(Group AI Assistant)要解决的核心问题——让AI从“单打独斗”走向“群体协作”,从“被动响应”升级为“主动参与”-6。

二、核心概念讲解:什么是群AI助手?

群AI助手(Group AI Assistant) ,全称多用户群聊智能助手,是指在大语言模型(Large Language Model,简称LLM)驱动下,能够在多人同时在场的群聊环境中实现主动参与、精准干预和多角色协作的智能系统。

群AI助手的核心内涵包括三个关键词:

多用户(Multi-User) :同时服务于多个用户,而非一对一对话。

主动干预(Proactive Intervention) :能够判断何时该发言、何时保持沉默,而非被动响应。

多角色协作(Multi-Agent Collaboration) :由多个分工明确的子Agent协同完成任务。

用一句话理解:群AI助手就像一个训练有素的“聊天团队成员” ,它知道什么时候该说话、什么时候该闭嘴,能保护隐私、理解多媒体内容,还能和其他AI成员配合完成任务。

群AI助手的核心价值:将群聊从“情绪陪伴”升级为“任务协作空间”-3。2025年11月OpenAI上线群组协作功能后,AI第一次不再是“被调用的对象”,而是具备协作角色的在场成员-3。

三、关联概念讲解:什么是多智能体系统(MAS)?

多智能体系统(Multi-Agent System,简称MAS) ,是指由多个相互独立的智能体(Agent)组成,通过结构化通信、任务分工和协作机制共同解决复杂问题的系统架构-6。

MAS与单智能体的对比

| 维度 | 单智能体 | 多智能体系统 |

|---|---|---|

| 核心模式 | “全能但孤独” | “分工协作的专家团队” |

| 任务处理 | 一个模型处理所有步骤 | 各Agent各司其职,并行执行 |

| 上下文长度 | 长上下文易冲突、难维护 | 每个Agent持有最小化知识库 |

| 调试难度 | “黑盒灾难”,难定位问题 | 职责清晰,可独立调试 |

| 成本 | 所有任务调用昂贵大模型 | 分级调用,按需使用 |

MAS的典型工作方式:“路由(Router)+ 执行者(Executor)” 架构-24。路由层负责识别消息并分发任务,只关心“谁最适合做”;执行层每个Agent只持有最小化的知识和工具,写代码的只管代码,查合规的只看条款。

四、概念关系与区别总结

一句话概括:群AI助手是“应用场景”,多智能体系统(MAS)是“底层架构” 。

群AI助手是面向用户的应用形态,强调的是“在群聊场景中为多用户提供AI服务”这一业务需求。

多智能体系统是技术实现手段,强调的是“如何通过多个Agent的分工协作来完成复杂任务”这一架构思想。

类比理解:MAS就像一支“交响乐团”的演奏机制——有指挥、有乐手、有分工、有协作;而群AI助手则是这支乐团在“群聊音乐会”这个具体舞台上的呈现。

两者关系:群AI助手是MAS思想在群聊场景中的具体落地。没有MAS的分工协作能力,群AI助手就无法实现“多人多Agent同时在场、围绕同一目标拆解任务、分工协作”的体验-3。

五、代码示例:基于AutoGen搭建一个简单的多智能体群聊

AutoGen是微软研究院开源的轻量级多智能体框架,将多智能体协作封装为“群聊(Group Chat)”模式-8。下面是一个极简示例:

安装:pip install pyautogen import autogen 1. 配置LLM(以GPT-4为例) config_list = [ { "model": "gpt-4", "api_key": "your-api-key", } ] 2. 创建三个专门化的智能体 程序员Agent:负责写代码 coder = autogen.AssistantAgent( name="Coder", llm_config={"config_list": config_list}, system_message="你是一名专业的Python程序员,只负责编写代码。" ) 测试员Agent:负责测试代码 tester = autogen.AssistantAgent( name="Tester", llm_config={"config_list": config_list}, system_message="你是一名测试工程师,负责检查代码错误并提出修改建议。" ) 项目经理Agent:负责协调 pm = autogen.AssistantAgent( name="PM", llm_config={"config_list": config_list}, system_message="你是项目经理,负责拆解任务、协调Coder和Tester的工作。" ) 3. 创建群聊管理器 groupchat = autogen.GroupChat( agents=[pm, coder, tester], messages=[], max_round=10 ) manager = autogen.GroupChatManager( groupchat=groupchat, llm_config={"config_list": config_list} ) 4. 用户发起任务 user_proxy = autogen.UserProxyAgent(name="User") user_proxy.initiate_chat( manager, message="帮我写一个计算斐波那契数列的函数,并测试一下前10项是否正确" )

执行流程拆解:

PM接收任务 → 将“写斐波那契函数”拆解为“Coder写代码”和“Tester测试验证”两个子任务。

Coder产出代码 → 生成

fibonacci(n)函数的Python实现。Tester验证 → 运行测试,检查输出是否符合预期,如有错误返回给Coder修改。

PM汇总输出 → 将最终代码和测试结果返回给用户。

这个示例展示了多智能体分工协作的核心思想:每个Agent只专注自己的职责,通过群聊机制完成复杂任务闭环-8。

六、底层原理与关键技术

群AI助手和多智能体系统的底层技术支撑主要包括以下四个层面:

1. 模型层:大小模型协作架构

以华东师范大学提出的GroupGPT框架为例,采用“小模型判断时机 + 大模型生成响应”的协作架构。小模型负责观察群聊氛围、决定是否需要AI介入,大大减少了token消耗——实验数据显示,该架构将计算成本降低了3倍-1-7。

2. 协议层:智能体间的“通用语言”

2025年至2026年,行业迎来了一系列关键协议的标准化:

MCP(Model Context Protocol,模型上下文协议)

A2A(Agent-to-Agent Protocol,智能体间协议)

ACP(Agent Communication Protocol,智能体通信协议)

ANP(Agent Network Protocol,智能体网络协议)

这四大协议共同构成了AI智能体通信的标准化底座-6。

3. 框架层:主流多智能体编排框架

AutoGen(微软):将多智能体协作封装为群聊模式

LangChain:生态最完善,抽象层级多但较重

LlamaIndex:更轻量,专注于数据索引和检索

CrewAI:强调角色定义和任务编排

4. 执行层:任务驱动架构

真正可落地的MAS必须具备完整的任务链路设计:任务拆解与规划(Planner Agent)、角色分工与并行执行(Executor Agents)、过程校验与纠错(Checker/Critic Agent)、状态管理与失败回滚(State/Recovery Agent)-23。

七、高频面试题与参考答案

Q1:什么是AI Agent?它与传统LLM聊天机器人有什么区别?

参考答案:AI Agent(智能体)是一个具备感知(Perception)、规划(Planning)、行动(Action)和记忆(Memory) 能力的自主系统。它以大语言模型(LLM)为核心,能够理解复杂指令,将任务分解,利用外部工具完成任务,并在过程中进行自我反思和学习-53。

与传统LLM聊天机器人的本质区别在于:

自主性:Agent能动态生成解决方案而非依赖预设规则

目标导向:Agent能将一个宏大目标拆解为子任务,自主选择工具和步骤执行

工具使用:Agent能主动调用外部工具(代码解释器、浏览器、API等)-53

💡 踩分点:务必说出“感知-规划-行动-记忆”四要素,以及与Chatbot的核心区别。

Q2:请解释ReAct框架的工作原理

参考答案:ReAct(Reasoning + Acting)通过交替执行“思考”与“行动”来解决复杂任务。其工作流程为-48:

观察阶段:接收用户输入与环境反馈

推理阶段:LLM生成思考链(Chain-of-Thought),决定下一步做什么

行动阶段:执行选定的动作(如调用工具、信息)

迭代优化:根据行动结果调整策略,循环往复直至任务完成

优势:减少幻觉,提升任务成功率。真实项目中使用ReAct可使复杂任务的准确率提升15%左右-59。

💡 踩分点:解释清楚“思考”和“行动”的交替循环,以及相比直接输出的优势。

Q3:如何设计一个生产可用的多智能体协作系统?

参考答案:设计生产级MAS需考虑以下关键点-58:

角色限定:给每个Agent定死角色,System Prompt里明确职责和输出格式

消息追踪:用JSON串起来,带上任务ID方便追踪和审计

异常处理:设置失败重试机制,对关键调用做人工兜底

争议仲裁:遇到Agent间意见冲突时,加入仲裁者Agent或设置人工介入点

避坑提醒:不要以为“多几个Agent就能协作更好”,MAS的核心是编排(Orchestration) 而非堆叠-24。

💡 踩分点:突出“编排”二字,给出具体的技术方案而非泛泛而谈。

八、结尾总结

回顾全文,我们梳理了以下核心知识点:

概念层面:群AI助手是应用场景,MAS是底层架构——场景驱动架构,架构支撑场景。

架构层面:MAS采用“路由+执行者”分工模式,让专业Agent做专业事。

实践层面:AutoGen等框架让多智能体协作的搭建变得简单,核心是理解“Agent群聊”的编排逻辑。

原理层面:群AI助手依赖大小模型协作、标准化通信协议和任务驱动架构三大技术底座。

面试层面:高频考点集中在“Agent vs LLM的区别”“ReAct框架”“多智能体协作设计”三个方向。

学习建议:本文旨在帮你建立概念框架。建议下一步深入学习AutoGen官方文档和ReAct论文原文,并动手运行文中的代码示例,在实战中加深理解。

🔔 预告:下一篇文章将深入拆解MCP协议原理与工具调用链的设计模式,敬请关注!